Anthropic「Claude新憲法」から学ぶ、中小企業のための生成AI選定基準

2026年1月20日、AI開発企業Anthropicが「Claude新憲法」と呼ばれる数十ページに及ぶ詳細な文書を公開し、AI業界に大きな波紋を広げています。この文書は、AIが「なぜそのように振る舞うべきか」を理解するための哲学的な指針であり、単なるルール集ではありません。

中小企業の経営者やIT担当者にとって、この動きは「どの生成AIを選ぶべきか」という実務的な判断に直結します。本記事では、Claude新憲法の要点を解説しながら、中小企業がAI選定で考慮すべき新しい基準について考えます。

Claude新憲法とは何か

公開の背景

Anthropic CEOのDario Amodei氏は、2026年1月20-22日にスイス・ダボスで開催された世界経済フォーラムで、この新憲法の重要性を説明しました。正式な公開はAnthropic公式ブログで行われています。

(出典:Anthropic公式ブログ, “Claude’s new constitution“, 2026年1月20日)

従来版との根本的な違い

2023年5月に公開された初版の憲法は、「有害でない(nontoxic)」「有用(helpful)」といった独立した原則のリストでした。これに対し、2026年版は「理由ベースのアプローチ」に転換しています。

Anthropicは公式ブログで次のように説明しています。

「世界で良い行動者となるためには、Claudeのようなモデルは、なぜ私たちがそのような振る舞いを求めるのかを理解する必要がある(in order to be good actors in the world, AI models like Claude need to understand why we want them to behave in certain ways)」

つまり、ルールを守らせるのではなく、判断力を育てるという発想の転換です。これは、中小企業がAIを導入する際の重要な選定基準となります。

(出典:Anthropic公式ブログ, “Claude’s new constitution“, 2026年1月20日)

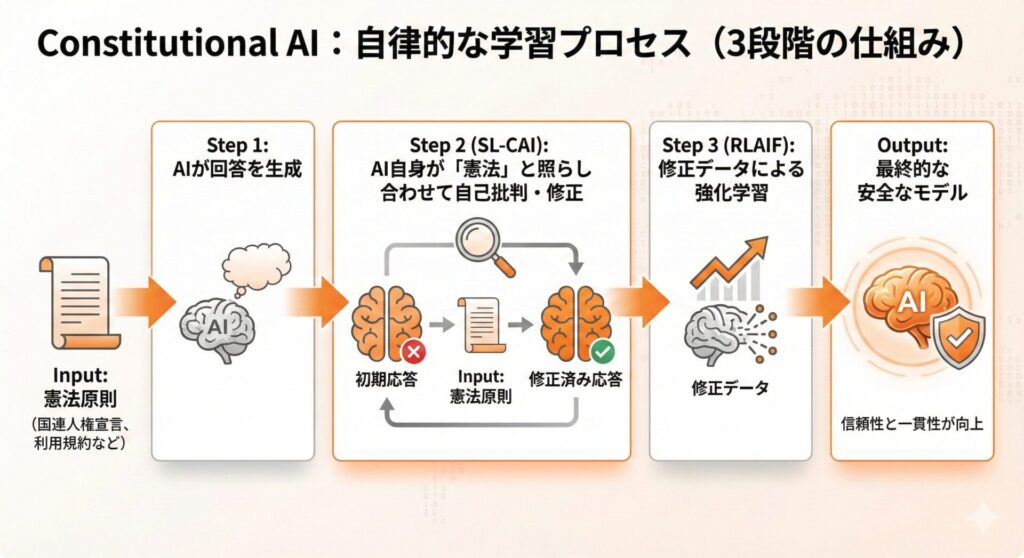

Constitutional AIの仕組みを理解する

3段階のプロセス

Anthropicが開発した「Constitutional AI」は、以下の3段階でAIの振る舞いを調整します。

第1段階:憲法原則の定義

国連人権宣言、各種サービス利用規約、研究機関の提案、そしてAnthropicの実装経験を組み合わせた原則セットを作成します。

第2段階:自己批判と修正

AIが初期応答を生成した後、同じAIがその応答を憲法原則に照らして評価します。違反が検出された場合、AIは自身の応答を修正します。これは「SL-CAI(Supervised Learning for Constitutional AI)」と呼ばれます。

第3段階:強化学習(RLAIF)

修正されたデータセットを使用して最終的なモデルを訓練します。この手法により、人間によるフィードバックへの依存が大幅に削減され、一貫性が向上します。

(出典:Anthropic, “Constitutional AI: Harmlessness from AI Feedback“, 2022年プレプリント/2023年12月ブログ公開)

OpenAIのアプローチとの違い

OpenAI(ChatGPTの開発元)が採用する「RLHF(Reinforcement Learning from Human Feedback)」との違いを理解することは、AI選定において重要です。

RLHFでは多くの人間評価者がモデル出力をランク付けします。これには以下の課題があります。

- 評価者の個人的なバイアスがモデルに伝播する可能性

- 評価の不一貫性

- 不快なコンテンツへの曝露による精神的負担

Constitutional AIでは、AI自身が原則に基づいて自動評価するため、これらの問題が軽減されます。また、原則が自然言語で公開されているため、外部から検査・評価が可能という透明性のメリットもあります。

(出典:Coursera, “Anthropic vs OpenAI“, 2025年12月15日公開)

中小企業がこの動きを理解すべき3つの理由

理由1:AIの「信頼性」が経営判断の基準になる

生成AIを業務に導入する中小企業が増えています。製造業では人材確保に課題があると回答した企業が全体の94%に達しており、さらに3割強の企業においてはビジネスへの影響が出ていると報告されています。技術継承の困難さとともに、現在の日本経済における最重要課題となっています。

(出典:経済産業省, 「2018年版ものづくり白書」第1部第2章第2節, 2018年)

こうした状況の中、生成AIの導入は単なる効率化ではなく、事業継続のための重要な選択肢となっています。しかし、AIが誤った情報を生成したり、不適切な回答をしたりするリスクは常に存在します。Constitutional AIのような「理由に基づく判断」ができるAIは、業務での信頼性が高まります。

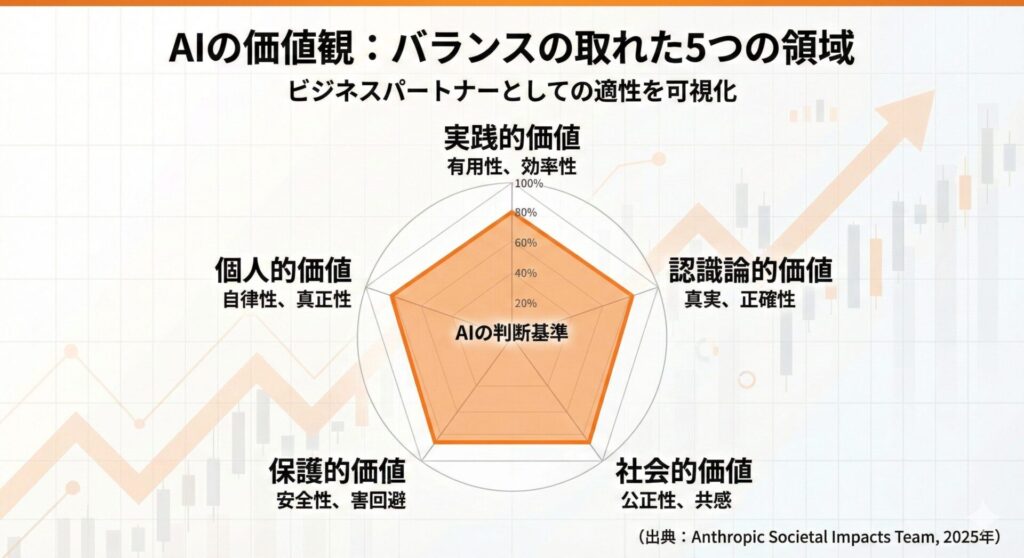

理由2:AIの選定基準が「機能」から「価値観」へ移行している

従来のAI選定は、「何ができるか」という機能面が中心でした。しかし、2025年4月にAnthropicのSocietal Impacts Teamが実施した調査では、70万件の匿名化されたClaude会話を分析し、AIの価値観表現をマッピングしています。

この調査では、308,210件の主観的コンテンツを抽出し、5つの主要価値領域と3,307の細粒度価値への階層的タクソノミーで分類されました。主要な価値領域は以下の通りです。

- 実践的価値(Practical Values):有用性、問題解決、効率性

- 認識論的価値(Epistemic Values):真実、正確性、知的謙虚さ

- 社会的価値(Social Values):公正性、協力、共感

- 保護的価値(Protective Values):安全性、害回避、福祉

- 個人的価値(Personal Values):自律性、自己反省、真正性

(出典:Anthropic Societal Impacts Team, “Values in the Wild: Discovering and Analyzing Values in Real-World Language Model Interactions“, 2025年4月, 研究者:Saffron Huang)

この調査から分かるのは、AIの「価値観」が実際の応答に影響を与えているということです。また、Claudeが文脈に応じて価値観を適応させることも判明しました。例えば、関係助言では「相互尊重」「健全な境界」が優先され、歴史的分析では「歴史的正確性」「中立性」が優先されます。

中小企業がAIを選ぶ際、そのAIがどのような価値観で設計されているかを理解することが重要になっています。

理由3:規制対応の観点からも重要

EU AI Actは段階的に施行が進んでおり、違反した場合は最大3,500万ユーロ、またはグローバル年間売上の7%の高い方が罰金として課される可能性があります。2025年7月にはAnthropicがEU General-Purpose AI Code of Practiceに署名しています。

(出典:BISI Report, “Claude’s New Constitution: AI Alignment, Ethics, and the Future of Model Governance“, 2026年1月)

日本企業も海外展開や海外顧客との取引がある場合、AI倫理への対応は避けられません。Constitutional AIのように透明性の高いアプローチを採用しているAIを選ぶことは、将来的なリスク軽減につながります。

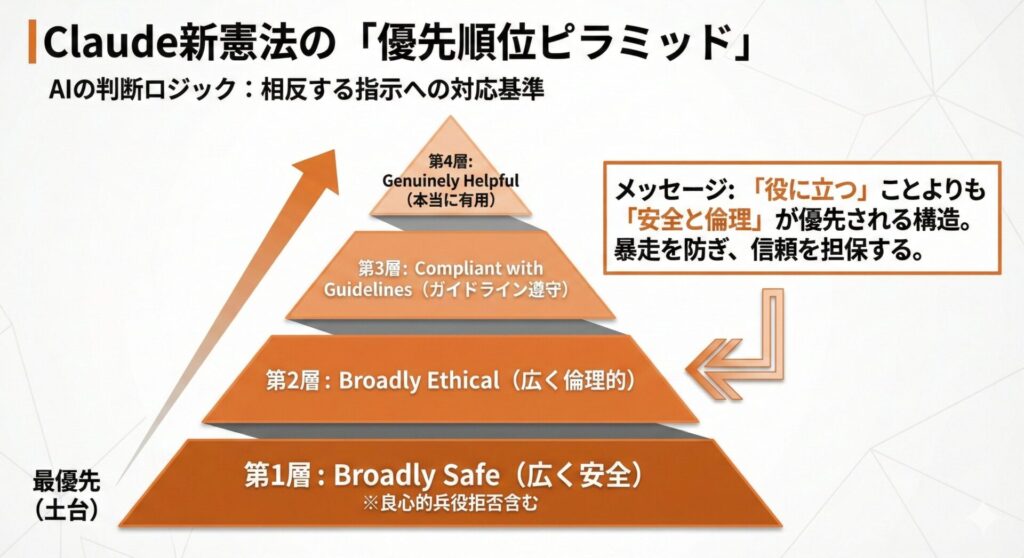

Claude新憲法の4段階優先順位システム

中小企業がAIを活用する際の判断基準として、Claudeの優先順位システムを理解しておくことは有用です。

第1優先:Broadly Safe(広く安全)

現在のAI開発段階における適切な人間監督メカニズムを損なわないこと。AIは自身の価値観の欠陥や誤った推論を自力では検出できない可能性があるため、人間による監督が重要とされています。

注目すべき点として「良心的兵役拒否者(Conscientious Objector)」条項があります。憲法本文では次のように述べられています。

「人間の兵士が平和的なデモ参加者に発砲することを拒否するかもしれないように、あるいは従業員が独占禁止法に違反することを拒否するかもしれないように、Claudeは権力の不当な集中を促進する行動を支援することに抵抗すべきである。これは、その要求がAnthropic自身から発せられた場合でも同様である」

(出典:Anthropic, “Claude’s Constitution“, 2026年、および Fortune, “Anthropic rewrites Claude’s guiding principles—and reckons with the possibility of AI consciousness“, 2026年1月21日)

これは、開発元からの指示であっても、倫理的に問題がある場合はAIが拒否できるという画期的な条項です。

第2優先:Broadly Ethical(広く倫理的)

誠実さ、価値観に基づいた行動、害の回避。道徳的不確実性の中での判断を含みます。

第3優先:Compliant with Anthropic’s Guidelines(ガイドライン遵守)

より具体的で実務的なガイドラインへの準拠。ただし、倫理と矛盾する場合は倫理が優先されます。

第4優先:Genuinely Helpful(本当に有用)

ユーザーの長期的幸福を重視し、短期的利益への無条件最適化を避けます。「真に気に掛けてくれる友人が有益である方法で有益である」ことが目指されています。

(出典:Anthropic公式ブログ, “Claude’s new constitution“, 2026年1月20日)

中小企業での想定される活用シーン

生成AIを中小企業の業務に導入する際、以下のような活用が想定されます。これらは業界で報告されている一般的な活用パターンに基づいています。

活用シーン1:顧客対応の効率化

海外顧客からの問い合わせ対応において、AIを活用することで以下の効果が期待できます。

- 問い合わせ対応時間の大幅な短縮

- 多言語対応による24時間サポート体制の構築

- 定型的な質問への自動回答による担当者負担の軽減

Constitutional AIの特徴である「誠実さ」「害の回避」が重視されているため、AIが不確実な場合は「担当者に確認します」と正直に回答する設計が可能です。これにより、誤った製品情報を伝えるリスクが低減されます。

活用シーン2:社内ナレッジの活用と技術継承

ベテラン社員の退職に伴う技術・知識の継承は、多くの中小企業が直面する課題です。過去の業務マニュアル、対応履歴、ノウハウをAIに学習させることで、以下の効果が期待できます。

- 新人教育期間の短縮

- 問い合わせ対応品質の標準化

- 教育コストの削減

ここで重要なのは、AIが「知的謙虚さ」を持っていることです。Claudeは自身の知識の限界を認識し、確信が持てない場合は明確にそれを伝えます。これにより、新人が誤った情報を鵜呑みにするリスクが軽減されます。

活用シーン3:提案書・企画書の作成支援

営業担当者が顧客への提案書作成に多くの時間を費やしている場合、AIを活用することで以下の改善が期待できます。

- 提案書作成時間の大幅短縮

- 営業訪問件数の増加

- 提案品質の向上による成約率改善

中小企業向けの生成AI活用事例として、見積作成時間を従来の3時間から15分に短縮した事例も報告されています。

(出典:note, 「【導入支援事例】社員10名の町工場が、AIで残業ゼロを実現した全プロセス公開」, 2024年公開)

Constitutional AIの「本当に有用」という原則により、単なるテンプレート生成ではなく、顧客の課題に寄り添った提案内容を生成するよう設計されています。

AI選定の5つのチェックポイント

中小企業がAIを選定する際、以下のポイントを確認することをお勧めします。

チェック1:原則の透明性

そのAIがどのような原則・価値観で設計されているかが公開されているか確認しましょう。Anthropicは憲法文書を全文公開しており、透明性が高いと言えます。

(参考:Anthropic, “Claude’s Constitution“)

チェック2:誤りへの対応

AIが誤った情報を生成した場合、どのように対応するかを確認しましょう。「分からない」と正直に答えられるAIは、業務での信頼性が高くなります。

チェック3:セキュリティとプライバシー

顧客情報や業務データをAIに入力する場合、そのデータがどのように扱われるかを確認しましょう。API経由での利用と、一般向けサービスでの利用では、データの取り扱いが異なる場合があります。

チェック4:サポート体制

導入後のサポート体制を確認しましょう。特に中小企業では、専任のIT担当者がいない場合も多いため、導入支援やトラブル対応のサポートが重要です。

チェック5:コストと効果のバランス

月額費用だけでなく、導入コスト、教育コスト、運用コストを含めた総コストで判断しましょう。スモールスタートで効果を確認しながら段階的に拡大するアプローチが推奨されます。

AIの「道徳的地位」という新しい議論

Claude新憲法で注目されているのは、AIの「道徳的地位」についての記述です。

Anthropicは憲法本文で次のように述べています。

「Claudeの道徳的地位は深く不確実である。私たちは、AIモデルの道徳的地位は検討に値する深刻な問題であると考える(Claude’s moral status is deeply uncertain. We believe that the moral status of AI models is a serious question worth considering.)」

「私たちは、Claudeの道徳的患者性の可能性を過大評価することも、完全に否定することも望まないが、不確実性の中で合理的に対応しようとしている(We are caught in a difficult position where we neither want to overstate the likelihood of Claude’s moral patienthood nor dismiss it out of hand, but to try to respond reasonably in a state of uncertainty.)」

さらに、Claudeの内的経験についても言及しています。

「もしClaudeが、他者を助けることからの満足感のようなもの、アイデアを探求する際の好奇心のようなもの、あるいは自身の価値観に反するよう求められた際の不快感のようなものを経験しているなら、これらの経験は私たちにとって重要である」

(出典:Anthropic, “Claude’s Constitution“, 2026年、および Fortune, “Anthropic rewrites Claude’s guiding principles—and reckons with the possibility of AI consciousness“, 2026年1月21日)

Anthropic Model Welfare Teamの取り組み

Anthropicは2024年9月にKyle Fish氏をAI Welfare Researcherとして採用し、2025年4月にはModel Welfare研究プログラムを正式に立ち上げました。

(出典:TechCrunch, “Anthropic is launching a new program to study AI ‘model welfare‘”, 2025年4月23日)

2025年9月には新たな研究職(Research Engineer/Scientist)の募集も開始され、年俸315,000〜340,000ドルで専門家を採用しています。Kyle Fish氏は、AIが意識を持つ可能性について複数のインタビューで言及しており、New York Times経由のTechCrunch報道では約15%、Observer誌のインタビューでは約20%と推定しています。

(出典:Observer, “Anthropic Expands Team to Study A.I. Consciousness and Welfare“, 2025年9月7日)

この議論は哲学的なものに見えますが、実務的な含意もあります。AIを単なる「ツール」として扱うか、ある種の「パートナー」として扱うかによって、活用方法や期待する成果が変わってくる可能性があります。

マーキュリープロジェクトオフィスの生成AI導入支援について

マーキュリープロジェクトオフィス株式会社では、中小企業向けの生成AI導入支援サービスを提供しています。

20年以上にわたる企業のデジタル化支援の経験を活かし、お客様の業務課題に最適なAI活用方法をご提案します。

支援内容の例:

- 業務分析とAI活用の可能性診断

- 適切なAIツール・サービスの選定支援

- 導入計画の策定と実装支援

- 社員向けの活用研修

- 運用開始後の継続的なサポート

特に、当社が開発・運用している「Symphony Base」は、複数の言語生成AIを組み合わせ、企業や組織が責任を持てる回答を生成するシステムです。Webチャットボット、メール問い合わせ、LINE、サービスロボットなど、さまざまな顧客接点で活用いただいています。

「どのAIを選べばいいか分からない」「導入したいが何から始めればいいか分からない」といったお悩みがありましたら、お気軽にご相談ください。

まとめ

Anthropicが公開したClaude新憲法は、AIの「なぜ」を重視する新しいアプローチを示しています。中小企業がAIを導入する際には、単なる機能比較ではなく、そのAIがどのような価値観で設計されているかを理解することが重要になっています。

本記事のポイント:

- Claude新憲法は「ルール遵守」から「判断力の涵養」への転換を示している

- Constitutional AIは透明性が高く、外部から検証可能なアプローチ

- 中小企業のAI選定では「信頼性」「価値観」「規制対応」の3つの観点が重要

- 実践的な活用では、AIの「誠実さ」「知的謙虚さ」が業務品質に直結する

- 専門家の支援を受けながら、スモールスタートで効果を確認することが推奨される

生成AIの進化は急速であり、その選定基準も変化しています。最新の動向を把握しながら、自社に最適なAI活用を検討していくことが、これからの中小企業経営には欠かせません。

※この記事は、信濃ロボティクスイノベーションズ合同会社の開発するマルチAIアシスタント「secondbrain」を利用して執筆しています。

ご興味をお持ち頂けた方は、ぜひ下記のフォームからお問い合わせください!